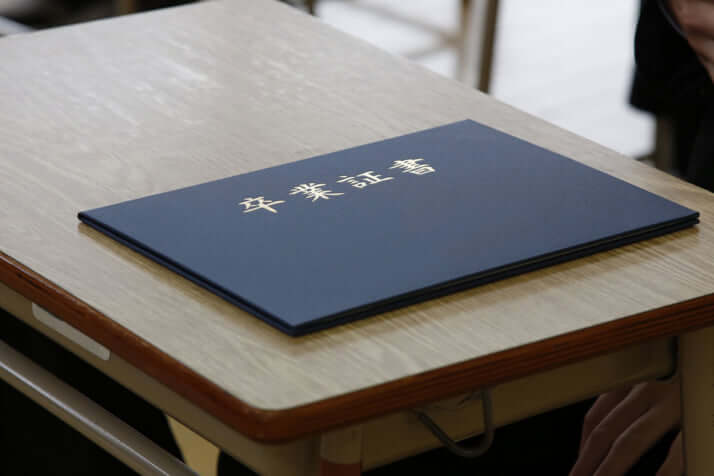

いまや「ニセ性的画像」の“素材”扱い…生成AIの悪用で“いじめ被害”にもつながりかねない学生時代の「思い出の品」に廃止論争

3月に各地で行われた卒業式。記念品とともに、卒業アルバム(以下、卒アル)が配布された人も多いはずだ。そんな卒アルだが、以前から“悪用”や“目的外使用”の問題が議論されてきた。掲載されている住所が名簿業者に売られるリスクも指摘される。

そして、コロナ騒動以降、急激に深刻度が増しているのが、生成AIを使ったディープフェイクの製作だ。卒アルの顔写真を使って、いかがわしい画像を捏造してしまうのだ。それは悪質な業者によって行われることもあるが、圧倒的に多いとされるのが、クラスメイトなどが“いじめ”のために生成する例である。【取材・文=山内貴範】

10代は生成AIのヘビーユーザー

NTTドコモの社会科学系の研究所である「モバイル社会研究所」が2025年11月に実施した全国調査によると、小学5年生では51%、中学生になると85%以上が自分用のスマホを利用しているのだという。調査によれば、スマートフォンの所有開始時期は男子10.4歳、女子はなんと10歳を下回り9.9歳という結果が出ており、年々、低年齢化が進んでいる。

スマホ所持者の低年齢化に伴って、今や、10代の子供たちは生成AIのヘビーユーザーだ。LINEのアイコン、部活動のチラシ、学級文集の表紙など、様々なものを生成AIで作り出している。彼らは小中学生の頃から当たり前にスマホを買い与えられたデジタルネイティブであり、同時に、生成AIネイティブとでもいうべき存在になっている。

そうしたなかで爆発的に増加し、巧妙化しているのがスマホと生成AIを使った“いじめ”である。一昔前のいじめといえば、校内暴力に代表される殴る蹴る、カツアゲをする、持ち物を隠す、などの表面化しやすい事例が多かった。しかし、今は“地下化”が進み、教師や親も被害を把握できなくなりつつある。

卒アルを使ったディープフェイクの生成

生成AIを使って、アイドルや芸能人、声優の破廉恥な画像を生成する事例がネットで相次いでいるが、生徒の顔写真を使ったヌードを作成される例もまた、多発しているのだという。例えば、LINEのグループで仲間外れにするだけでなく、卑猥な画像を生成して、誹謗中傷する。精神的に追い詰めるスタイルのいじめが、さらに陰湿なものになっている。

ある公立中学校で30年近く教師を務めているA氏が、昨年まで担任をしていた生徒も、こうしたいじめの被害に遭っていたという。相談を受け、いじめの加害者に注意をしたというが、その実態は目を覆いたくなるようなものだったという。

「被害者の子供は小学校の頃の卒アルや、修学旅行の写真を使われ、卑猥な画像を生成されていました。加害者たちの執念は凄まじく、嫌いな相手をいじめるためなら、徹夜してでも画像を生成してしまう。さらに、教師側もデジタルに疎く、そういったいじめがあることを知らない例も多いのです」

災害被災地の様子と称したディープフェイクが問題になったように、現在の生成AIの画像は、一見しただけでは本物と区別がつきにくい。写真はもちろん、動画も本物としか思えないほど精度の高いものを生み出せる。卑猥なポーズだけではなく、悪さをしている画像もいくらでも生成可能だ。まさに、生成AIはいじめの恰好のツールになっているのである。

[1/2ページ]