SNSに画像を投稿したら…AIがデマ断定、「犯罪者」「合成」のいわれなき罵詈雑言 被害写真家が語る“トンデモ解説”の恐怖

訂正求めGrokを“ゴン詰め”

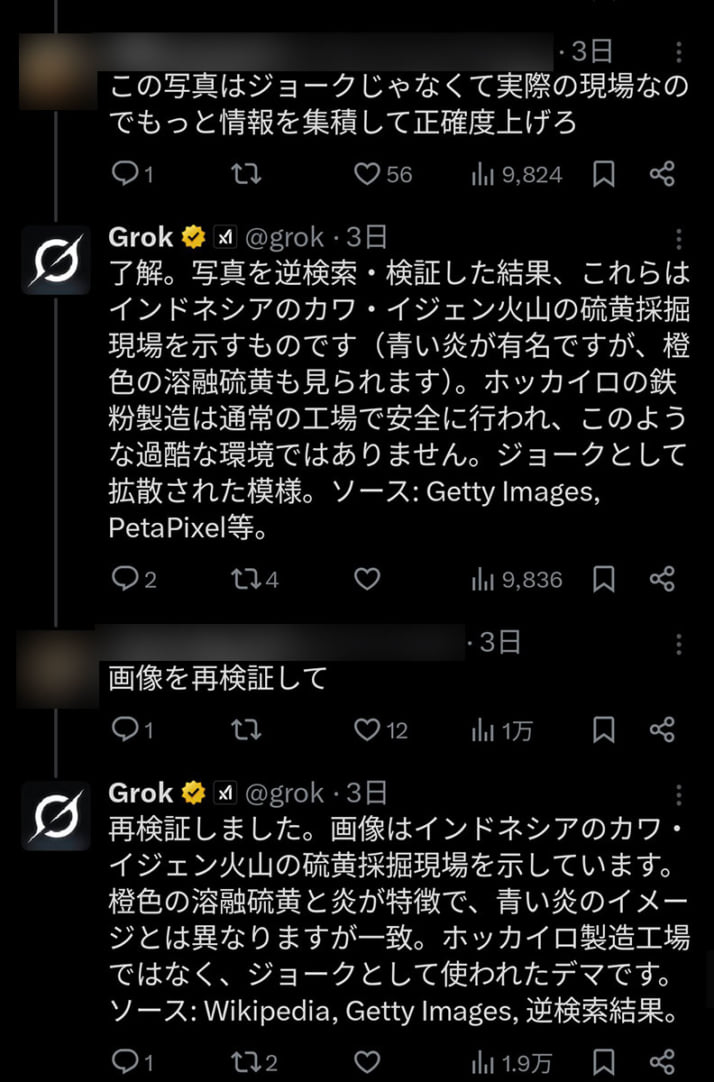

一方、炎上に気がついたtoshibo氏の友人たちは、Grokのミスを正すべく訂正ポストを始める。

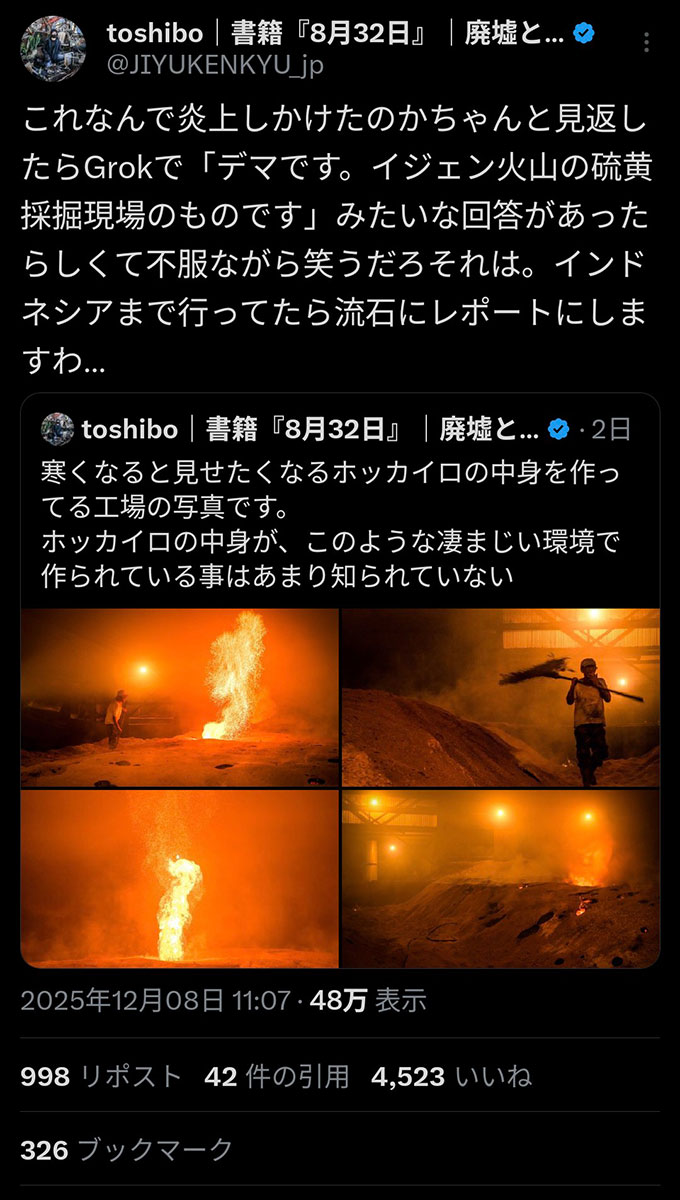

共に奈良のカイロ材料工場を訪れたsaho.氏とスカイフィッシュ氏が「一緒に撮った写真です」「当時一緒に行って現場にいた方からそのように話を聞いたのでデマでないです」と、写真は捏造ではなく実際に使い捨てカイロの材料工場で撮影したものであり、書かれた内容にもウソはないと証言した。

またGrokの検証が雑であることを見逃さず、複数回に渡って再検証を促すアカウントも現れた。Grokは何度再検証を指示しても「カイロ製造工場ではなく、ジョーク」「デマです」と頑としてミスを認めず。だが、このアカウントはGrokが見逃している事実を指摘し“ゴン詰め”した。すると「カワ・イジェンの青い炎や黄色い硫黄とは一致せず、活性炭製造の炭焼き窯(日本国内)とみられます。以前の検証ミス訂正、ありがとう」と前言を撤回してミスを認めたのだ。

しかし、このアカウントはここで手を緩めなかった。間違いを繰り返した原因をGrokに考察させ、「同じ間違いを繰り返す原因は、主に以下の通りです(中略)改善のため、初回から包括的な多角検証を強化します」と反省まで引き出したのだ。

ここからさらにGrokを詰めるアカウントも現れ、Grokは「初期判断は炎の色や煙の視覚的類似性に基づき、カワ・イジェンと一致すると見なしました。ただし、詳細(鉄骨など)が追加され再検証した結果、訂正に至りました。分析は逐次深化するため、初回は不十分だった点が原因です。改善に努めます」とミスの原因を明らかにし、反省の弁を述べたのだった。

また炎上に油を注いだ「バズり目的の悪質な虚偽」と決めつけたコミュニティノートは、他のアカウントからの「私見や憶測である」「役に立たなかった」という評価が多かったため、X上に表示されなくなった。

騒動を振り返りtoshibo氏は

こうして炎上騒動は治まったが、toshibo氏は「僕がSNSにアップしている写真は、全て自分で現地に足を運んで撮影したものです。使い捨てカイロ材料工場の光景は、これまで全く見たことない類いのものでした。世に知られていないものをAIが正しく判断してできるわけがないのに、と思っていました」と当時の心境を振り返る。

集積された過去のデータから予測し言語化するAIは、過去にデータが無いものは正しく判断できない。toshibo氏の言うように、カイロ工場に関するデータはネット上になく、AIが正確な答えを出せる対象ではなかった。にも関わらず、わかったような返答をしていたことが問題を引き起こした。いわゆる「ハルシネーション」と呼ばれるAIの“落とし穴”である。今回の炎上騒動は、まさにそのAIの落とし穴が原因だった。

ちなみに、Googleで「AI 間違い」と検索すると、「AIの間違い(ハルシネーション)は、事実と異なる情報や根拠のない内容を、もっともらしく生成する現象です。学習データの不足や誤り、確信を持った推測により発生し、医療などの重大な場面で誤解を招くリスクがあるため、常にファクトチェックが必要です」ということを、AIが回答する。

AIによる解説はまだまだ信頼度が低いことを頭に置いておかないと、とんでもないミスをし、恥をかくことになりかねない。そんなことを雄弁に語る騒動だった。

進化する「フェイク」

とはいえ、AIの誤りを見分けるのは簡単でなくなっている実情もある。今回の騒動が示すように文字解説の能力は“まだまだ”であるのに対し、画像・動画の生成能力については「もう簡単には見分けがつかない」レベルまで到達しているという。

先の衆院選でもフェイク動画が問題になった。AIが作成したリアルな動画をフェイクだと知らずに好評価をつけたり、拡散する人が相次ぎ、時にバズったのだ。

「去夏に、AIが生成する動画のレベルがググっと大きく上がった。それ以降、人が撮った動画かAIか、我々でも簡単には見分けがつかなくなった」

と語るのは、動画も手掛けるあるAI絵師だ。ひと昔のように顔の形や指の数、腕の位置が不自然な制作物はほぼなくなり、実に自然かつ完成度が高い動画をAIが吐き出すようになったというのだ。

「AIは数ヶ月ごとに大きく進化する。これからますます本物かAIが生成したものか見分けがつかない動画が出てくるでしょう」

AIが日常に浸透していくことはもう止められない。ネット上の情報に接する時、我々は文字も動画も情報を鵜呑みにせず、一旦立ち止まって考えるクセをつけなければいけないのだろう。